Imagina conectarte a una videollamada con tu jefe o un colega de confianza… y descubrir después que nunca fueron ellos. Esa persona que viste y escuchaste era una falsificación digital creada por inteligencia artificial. Parece ciencia ficción, pero es la nueva realidad de la ciberseguridad.

Los deepfakes y la IA adversaria han abierto un terreno de riesgo que va mucho más allá de los virus tradicionales o el phishing. Hoy, los atacantes pueden imitar voces, gestos y expresiones de manera tan realista que incluso un ojo entrenado puede caer en la trampa. Y lo están usando para algo muy concreto: estafas millonarias, manipulación de decisiones críticas y acceso a información confidencial.

De la percepción a la manipulación

Hasta ahora, muchos confiaban en señales humanas para validar lo que ocurría: “si lo escucho de su voz”, “si lo veo en la pantalla”, “si me lo dice en una reunión en vivo”. Ese terreno de confianza se está desmoronando. Los ciberdelincuentes saben que un video o un audio resultan más convincentes que un correo sospechoso, y por eso están utilizando estas tecnologías para hacer caer incluso a los empleados más atentos.

Un error ya no significa solo abrir un enlace malicioso: puede ser autorizar una transferencia millonaria, desactivar un sistema de seguridad o entregar acceso privilegiado pensando que la instrucción viene de un superior.

Ejemplos que ya ocurrieron

-

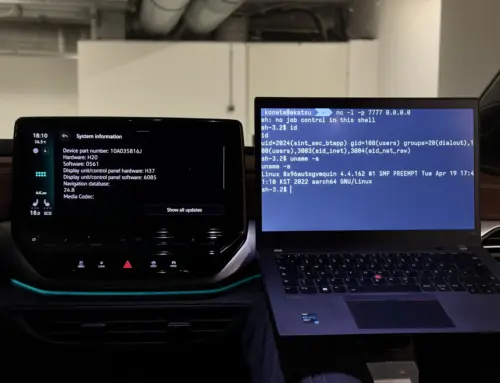

Un caso en Hong Kong terminó con más de 25 millones de dólares transferidos tras una videollamada falsificada de un director financiero.

-

Ejecutivos en Europa han recibido llamadas con voces clonadas de sus jefes para autorizar pagos urgentes.

-

Se han detectado intentos de fraude donde se usan chatbots con IA que se hacen pasar por soporte técnico, logrando robar credenciales de acceso.

Estos no son ensayos: son delitos reales que prueban lo rápido que esta amenaza está creciendo.

Entonces, ¿cómo nos defendemos?

No existe una solución única ni mágica. La clave está en combinar tres pilares:

-

Tecnología inteligente: usar herramientas capaces de detectar patrones que delatan un deepfake, algo casi imposible para el ojo humano.

-

Procesos claros: validar siempre por más de un canal antes de ejecutar una acción sensible. La vieja regla de “confía, pero verifica” nunca fue tan importante.

-

Cultura de seguridad: entrenar a los equipos para que no teman cuestionar, confirmar y levantar alertas, incluso si la solicitud parece venir de la persona con más autoridad.

La importancia de la asesoría experta

Las organizaciones no pueden enfrentar solas este nuevo escenario. Se requiere experiencia para anticipar riesgos, actualizar protocolos y desplegar medidas efectivas antes de que ocurra el incidente. Porque cuando la realidad puede ser falsificada, lo más seguro es contar con alguien que ya ha visto cómo se mueven los atacantes y sabe cómo responder.

La pregunta ya no es si veremos intentos de fraude basados en deepfakes e IA, sino cuándo. Y en ese momento, la preparación marcará la diferencia entre una anécdota controlada o una crisis millonaria.